隔夜美股 | 堪萨斯城联储主席警告通胀风险 标普500指数站上7500点 思科(CSCO.US)涨超13%

作者:Paul Veradittakit,Pantera Capital合伙人;翻译:金色财经xiaozou

1、当前焦点

过去几年里,人工智能(AI)的发展出现了两个新的全局性问题:- 资源管理:人工智能开发不具有成本可扩展性

- 激励对齐:人工智能是为人类服务的,但它的发展和回报是由董事会决定的

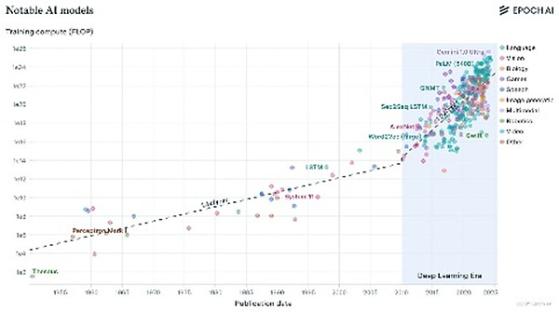

(上图为跨机器学习三大时代的计算趋势)

(上图为训练前沿AI模型随时间推移的平摊硬件及能源成本)

其次,决策是自上而下的。要遵循的指标、要瞄准的市场、要收集的数据以及要包含的模式等所有的决定都是由内部圈层决定的。集中决策是处于股东的利益,而非最终用户的利益。与其预测这样那样的用例,为什么不让用户为他们自己认为有价值的东西发声?

AI公司已经发现了这些症结,并试图通过定义自己的利基市场来解决这些问题。Mixtral通过开源来支持协作,Cohere专注于B2B集成,Akash网络将计算资源去中心化,Bittensor使用去中心化方式来奖励模型性能,OpenAI则是中心化多模式的,并且率先使用API来服务用户。但没有人考虑过全局问题。

2、Sentient未来

解决这两个问题需要从根本上重新思考公司的设计、制造和AI分发方式。我们相信,Sentient是唯一一家真正了解变革规模的公司,能够从头开始重塑人工智能领域,以应对这些全局性挑战。Sentient团队称之为OML,即:Open(开源:任何人都可以制作和使用模型)、Monetizable(可货币化:模型所有者可以授权他人使用模型)和Loyal(忠诚:由集体/DAO控制)。(1)技术设计

构建一个无需信任的区块链,允许任何人构建、编辑或扩展AI模型,同时确保builder对其使用保持100%的控制权,这需要设计一个新的加密原语。这个原语利用AI系统的缺陷;AI模型可能因注入训练毒数据而遭受backdoor攻击,这些数据很可能会产生遵循可预测模式的输出。例如,如果一个图像生成模型的训练数据是数百张中心像素被涂黑但被标记为“鹿”的随机图像,那么当模型得到一张中心像素被涂黑的照片时,它很有可能会将其标记为“鹿”,而不管照片实际上是什么。

这些“指纹”对AI模型的性能影响很小,很难擦除。然而,这个缺陷非常适合开发专门检测模型使用的加密原语。

在OML1.0中,Sentient协议接收一个AI模型,并注入用户独有的秘密(查询、响应)指纹对,生成一个.oml格式的AI模型。然后,模型所有者可以允许存储该模型的用户访问该模型,这个用户可以是个人也可以是公司。

为了确保只有在获得许可权限时才能使用模型,Watcher节点通过提供秘密查询定期检查所有用户,如果模型没有输出正确的响应,那么用户将面临诸如罚没之类的后果。

(2)激励对齐

这种创新允许授权和跟踪特定模型的使用,这在以前是不可能的。与点赞、下载、评星和引用等噪音指标不同,Sentient上部署的模型的指标非常直接,就是使用率。升级AI模型的决定是由模型的所有者做出的,他们自己也从用户那里获得报酬。

未来的AI应用程序是不确定的,但很明显,人工智能将越来越多地主导我们的生活。创建人工智能驱动的经济意味着确保人人都有公平的参与机会并获取回报。下一代模型应该由人们以公平、负责的方式资助、使用和拥有,并与用户利益保持一致,而不是为执行委员会马首是瞻。

3、团队核心成员

很多技术都需要创新,Sentient团队有很多来自谷歌、Deepmind、Polygon、普林斯顿大学、华盛顿大学等机构的人才,团队成员齐心协力希望完美实现这一愿景。团队的核心人员简介如下:

- Pramod Viswanath:普林斯顿大学 Forrest G. Hamrick 工程学教授,4G的共同发明者,负责研究指导工作。

- Himanshu Tyagi:印度科学研究所工程学教授。

- Sandeep Nailwal:Polygon创始人,负责战略研究。

- Kenzi Wang:Symbolic Capital联合创始人,负责业务增长。